Redes neuronales recurrentes

Redes neuronales recurrentes es un tipo de redes neuronales artificiales que se utiliza para procesar datos en serie. Se diferencian de otros tipos de redes neuronales en que tienen retroalimentaciones que almacenan información sobre estados previos.

Redes neuronales recurrentes es un tipo de redes neuronales artificiales que se utiliza para procesar datos en serie. Se diferencian de otros tipos de redes neuronales en que tienen retroalimentaciones que almacenan información sobre estados previos.

Las redes neuronales recurrentes son adecuadas para trabajar con series temporales, textos y otros datos que tengan una estructura interna. Por ejemplo, se utilizan para el reconocimiento de voz, la traducción automática y el análisis de sentimientos de texto.

La principal ventaja de las redes neuronales recurrentes es que procesan datos de diferentes longitudes. Esto significa que pueden trabajar con textos de diferente extensión o series temporales con diferente número de puntos.

Sin embargo, las redes neuronales recurrentes también tienen dificultades. Requieren más recursos computacionales y tiempo para entrenar que otros tipos de redes neuronales. Además, sufren el problema del decaimiento del gradiente, donde los gradientes se vuelven pequeños y dificultan el entrenamiento.

A pesar de estas complejidades, las redes neuronales recurrentes son una excelente herramienta para trabajar con datos en serie y se utilizan en todo tipo de áreas.

El contenido del artículo:

- El principio de funcionamiento de las redes neuronales recurrentes.

- ¿Qué es LSTM?

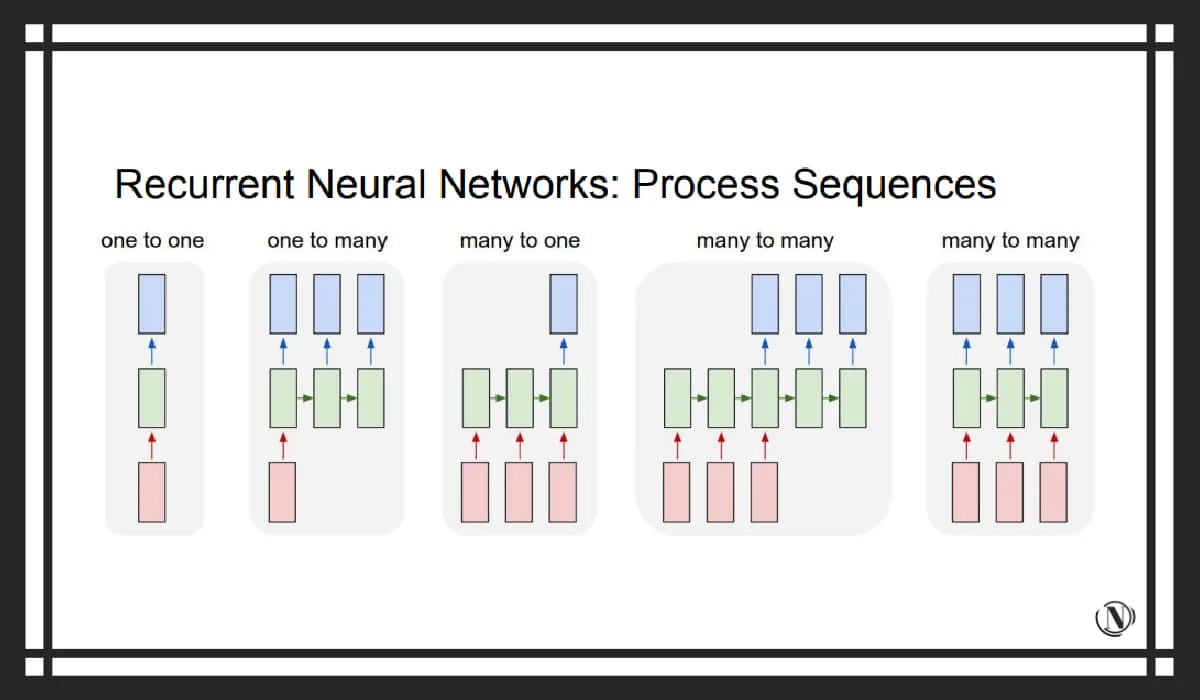

- Tipos de redes neuronales recurrentes

- Arquitectura de redes neuronales recurrentes

- Entrenamiento de redes neuronales recurrentes

- ¿Ejemplos del uso de redes neuronales recurrentes en los negocios?

- ¿Qué empresas utilizan redes neuronales recurrentes?

- Ventajas y limitaciones de las redes neuronales recurrentes

- El futuro de las redes neuronales recurrentes

- Conclusión

- Preguntas frecuentes

El principio de funcionamiento de las redes neuronales recurrentes.

Redes neuronales recurrentes (RNN) es un tipo de redes neuronales artificiales que se utiliza para procesar datos en serie. Las RNN se diferencian de otros tipos de redes neuronales en que tienen retroalimentación que retiene información sobre estados anteriores.

A diferencia de otras redes neuronales que procesan cada elemento de entrada de forma independiente, las redes neuronales recurrentes utilizan información sobre estados anteriores para procesar el elemento de entrada actual. Es así como RNN toma en cuenta el contexto y procesa secuencias de datos.

Una forma progresiva de implementar redes neuronales recurrentes es el uso de células de memoria.

celda de memoria es un elemento de una red neuronal que almacena información sobre estados previos. Toma el elemento actual y el estado anterior de la celda de memoria como entrada y calcula un nuevo estado basado en estos datos.

Un tipo popular de celdas de memoria es LSTM (Memoria a corto plazo largo). LSTM tiene tres puertas de entrada: una puerta de entrada, una puerta olvidada y una puerta de salida. Estas puertas controlan el flujo de información dentro de una celda de memoria, ya que el LSTM almacena información sobre dependencias a largo plazo entre elementos de secuencia.

¿Qué es LSTM?

LSTM (Memoria a corto plazo largo) es un tipo de red neuronal recurrente diseñada específicamente para manejar dependencias a largo plazo entre elementos de secuencia. El LSTM tiene una arquitectura compleja con tres puertas de entrada: una puerta de entrada, una puerta ajena y una puerta de salida. Estas puertas controlan el flujo de información dentro de una celda de memoria, ya que el LSTM almacena información sobre dependencias a largo plazo entre elementos de secuencia.

LSTM está diseñado para resolver el problema de la caída del gradiente que ocurre cuando se entrenan redes neuronales recurrentes. Permite que la red maneje dependencias a largo plazo entre elementos de una secuencia y se usa en todo tipo de áreas, como reconocimiento de voz, traducción automática y análisis de sentimientos de texto.

¿Qué otros tipos de redes neuronales recurrentes hay?

Hay muchas redes neuronales recurrentes. Algunos de ellos incluyen:

- Red con memoria a corto y largo plazo (LSTM)

- Unidad Recurrente Administrada (GRU)

- Red totalmente recurrente

- red recursiva

- Red neuronal Hopfield

- Memoria asociativa bidireccional (BAM)

- Redes de Elman y Jordan

- redes de eco

- Compresor de historia neuronal.

Cada uno de estos tipos tiene sus propias características y se utiliza en diversas tareas.

Arquitectura de redes neuronales recurrentes

La arquitectura de las redes neuronales recurrentes (RNN) difiere de la arquitectura de otras redes neuronales en presencia de retroalimentación. Los enlaces RNN almacenan información sobre estados anteriores y la utilizan para procesar el elemento de entrada actual.

El elemento principal de la RNN es la celda de memoria. La celda recibe el elemento actual y el estado anterior de la celda de memoria como entrada y calcula un nuevo estado basado en estos datos. Las celdas de memoria vienen en diferentes tipos, según la arquitectura RNN utilizada.

- Un tipo común de celda de memoria es el LSTM (Memoria a corto plazo largo). Tiene tres puertas de entrada: una puerta de entrada, una puerta de olvido y una puerta de salida. Estas puertas controlan el flujo de información dentro de una celda de memoria, ya que el LSTM almacena información sobre dependencias a largo plazo entre elementos de secuencia.

- Otro tipo de celda de memoria popular es el GRU (Unidad Recurrente Cerrada). Tiene dos puertas de entrada: una puerta de renovación y una puerta de descarte. Estas puertas controlan el flujo de información dentro de una celda de memoria, por lo que la GRU mantiene información sobre dependencias a largo plazo entre elementos de secuencia.

Entrenamiento de redes neuronales recurrentes

Las redes neuronales recurrentes (RNN) se entrenan utilizando el algoritmo de retropropagación en el tiempo (Retropropagación a través del tiempo, BPTT). Este algoritmo es similar al algoritmo de retropropagación estándar que se utiliza para entrenar otras redes neuronales, pero con una gran diferencia: tiene en cuenta la estructura temporal de los datos.

Durante el entrenamiento, se presenta una RNN con una secuencia de entradas y una secuencia correspondiente de salidas deseadas. La red procesa la entrada y calcula su salida. A continuación, se calcula el error entre la salida de red deseada y la real.

Este error luego se propaga hacia atrás en el tiempo para calcular los gradientes para cada parámetro de red. Estos gradientes se utilizan para actualizar los parámetros de la red mediante un algoritmo de optimización como el descenso de gradiente estocástico.

Sin embargo, el entrenamiento de RNN se ve obstaculizado por el problema del desvanecimiento o explosión del gradiente. Esto significa que los gradientes se vuelven pequeños o grandes, lo que dificulta el entrenamiento. Se utilizan técnicas para resolver este problema, como la limitación de la norma de gradiente o el uso de tipos de celdas de memoria avanzadas como LSTM o GRU.

¿Ejemplos del uso de redes neuronales recurrentes en los negocios?

Las redes neuronales recurrentes (RNN) se utilizan en los negocios para resolver problemas relacionados con el procesamiento de datos en serie. Algunos ejemplos de aplicaciones RNN incluyen:

- Pronóstico de series de tiempo: Los RNN se utilizan para predecir series de tiempo como ventas, precios de acciones y clima. Esto puede ayudar a las empresas a tomar decisiones informadas y planificar actividades.

- Análisis de sentimiento de texto: RNN se utiliza para analizar el sentimiento del texto para determinar si la reseña es positiva o negativa. Esto puede ayudar a las empresas a mejorar su producto o servicio y aumentar la satisfacción del cliente.

- Traducción automática: los RNN se utilizan para la traducción automática de texto de un idioma a otro. Esto puede ayudar a las empresas a expandir el mercado y comunicarse con los clientes en diferentes idiomas.

- Reconocimiento de voz: Los RNN se utilizan para el reconocimiento de voz y la conversión de voz a texto. Esto puede ayudar a las empresas a mejorar las interfaces de voz y mejorar la experiencia del cliente.

Estos son ejemplos de cómo se utilizan las RNN para resolver problemas cotidianos. Los RNN son herramientas en demanda para mejorar productos y servicios y aumentar la eficiencia operativa.

¿Qué empresas utilizan redes neuronales recurrentes?

Las redes neuronales recurrentes son utilizadas por las empresas para resolver todo tipo de problemas. Por ejemplo:

- Google utiliza redes neuronales recurrentes para el reconocimiento de voz en productos como Google Assistant y Google Translate. Google también los usa para traducir automáticamente texto de un idioma a otro.

- Amazon utiliza redes neuronales recurrentes para analizar el sentimiento de las reseñas de productos en su sitio web. Esto les ayuda a mejorar la calidad de sus productos y servicios.

- Netflix utiliza redes neuronales recurrentes para predecir los intereses de los usuarios y recomendar películas y programas de televisión.

Estos son tres ejemplos de cómo las empresas agregadoras utilizan redes neuronales recurrentes en su trabajo.

Ventajas y limitaciones de las redes neuronales recurrentes

Las redes neuronales recurrentes (RNN) tienen una serie de ventajas sobre otros tipos de redes neuronales. La principal ventaja de RNN es la capacidad de procesar datos en serie. Debido a la presencia de retroalimentaciones, las RNN almacenan información sobre estados anteriores y la utilizan para procesar el elemento de entrada actual. Entonces, los RNN tienen en cuenta el contexto y procesan las secuencias de datos.

Sin embargo, RNN también tiene una serie de limitaciones. Por ejemplo, el problema de desvanecer o explotar un degradado. Esto significa que los gradientes pueden ser pequeños o grandes, lo que dificulta el entrenamiento. Se utilizan técnicas para resolver este problema, como la limitación de la norma de gradiente o el uso de tipos de celdas de memoria avanzadas como LSTM o GRU.

Además, el entrenamiento de RNN es computacionalmente costoso debido a la necesidad de propagar el error en el tiempo. Esto dificulta el uso de RNN para procesar secuencias de datos largas.

El futuro de las redes neuronales recurrentes

Las redes neuronales recurrentes (RNN) son áreas emergentes de investigación en inteligencia artificial. En el futuro, se espera que las RNN se utilicen para resolver problemas extremadamente complejos relacionados con el procesamiento de datos en serie.

La dirección principal del desarrollo de RNN es mejorar su capacidad para manejar dependencias a largo plazo entre elementos de secuencia. Esto se puede lograr mediante el uso de tipos avanzados de celdas de memoria, como LSTM o GRU, o mediante nuevas soluciones arquitectónicas.

Además, se espera desarrollar nuevos métodos de entrenamiento de RNN que les permitan procesar grandes cantidades de datos rápidamente. Esto puede incluir el uso de computación paralela y aprendizaje distribuido.

El futuro de RNN parece prometedor. Seguirán desempeñando un papel importante en el campo de la inteligencia artificial y se utilizarán para resolver problemas extremadamente complejos.

Conclusión

En este artículo, hemos discutido varios aspectos de las redes neuronales recurrentes (RNN). Consideró su principio de funcionamiento, arquitectura, aplicación, ventajas y limitaciones, así como el desarrollo futuro.

RNN es una herramienta esencial para el procesamiento de datos en serie. Las redes neuronales recurrentes tienen retroalimentación que les permite almacenar información sobre estados anteriores y usarla para procesar el elemento de entrada actual. Esto les permite ser conscientes del contexto y procesar secuencias de datos.

Sin embargo, los RNN también tienen una serie de limitaciones, como el problema de la caída o explosión del gradiente y la alta complejidad computacional del entrenamiento. En el futuro, se espera que se desarrollen nuevos métodos y arquitecturas que permitan a las RNN resolver rápidamente problemas extremadamente complejos.

Preguntas frecuentes

P: ¿Qué son las redes neuronales recurrentes?

R: Las redes neuronales recurrentes (RNN) son un tipo de red neuronal artificial que se utiliza para procesar datos en serie. Las RNN se diferencian de otros tipos de redes neuronales en que tienen retroalimentación que les permite retener información sobre estados anteriores.

P: ¿Cuáles son las ventajas de las redes neuronales recurrentes?

La principal ventaja de las redes neuronales recurrentes es la capacidad de procesar datos secuenciales. Debido a la presencia de retroalimentaciones, las RNN pueden almacenar información sobre estados anteriores y utilizarla para procesar el elemento de entrada actual. Esto les permite ser conscientes del contexto y procesar secuencias de datos.

¿Cuáles son las limitaciones de las redes neuronales recurrentes?

Una de las limitaciones de las redes neuronales recurrentes es el problema del desvanecimiento o explosión del gradiente. Esto significa que los gradientes pueden ser pequeños o grandes, lo que dificulta el entrenamiento. Además, el entrenamiento de RNN puede ser computacionalmente costoso debido a la necesidad de propagar el error en el tiempo.

¿Cuáles son algunos ejemplos del uso de redes neuronales recurrentes en los negocios?

Las redes neuronales recurrentes se utilizan en los negocios para resolver todo tipo de problemas. Por ejemplo, para pronósticos de series temporales, análisis de sentimientos de texto, traducción automática y reconocimiento de voz. Puede ayudar a las empresas a mejorar los productos y servicios y mejorar la eficiencia del trabajo.

Leyendo este artículo:

- Redes neuronales recursivas

- Red neuronal para escribir artículos: una nueva era del marketing de contenidos

Gracias por leer: ✔️ AYUDANTE DE SEO | NICOLA.TOP